Künstliches Bewusstsein / Jonathan Haidt vs Mark Zuckerberg / Wert unbezahlter Moderations-Arbeit / Komplexitäten der Social Media Kritik

A bunch of posts I wrote for the expert-community Piqd in the past weeks

After 4 years, I’m still not and never will be over what happened, but i decided that readers should not be the ones who suffer from it. Sorry about the mess other people created in my life. We’ll go on from here. If you know what I’m talking about: Don’t mention the war. If you are one of them: Stay out of my life, forever.

Die Debatte um künstliches Bewusstsein in AI-Systemen

Im Februar dieses Jahres erregte OpenAI-Gründer Ilya Sutskever mit einem kurzen Tweet eine ganze Menge Aufmerksamkeit bei AI-Experten und Philosophen gleichermaßen: "it may be that today's large neural networks are slightly conscious", zu Deutsch: "Es könnte sein, dass die heutigen Large Neural Networks über geringes Bewusstsein verfügen." Der Tweet provozierte hunderte von Antworten von AI-Experten aus allen Bereichen, einen Überblick über die Diskussion findet man zum Beispiel hier.

Vor wenigen Tagen wurde die Debatte neu angeheizt durch die Veröffentlichung eines Interviews, dass ein Google-Mitarbeiter mit dem Chatbot-System LaMDA geführt hatte. Blake LeMoine hatte unter anderem auch einen rechtlichen Beistand für die künstliche Intelligenz gefordert und behauptet, sie sei "sentient", also empfindungsfähig. Auf Medium berichtet er über Hintergründe und Motivationen seiner Arbeit und legt dar, was LaMDA "will". Nur wenige Tage zuvor hatte Googles führender AI-Engineer Blaise Agüera y Arcas im Economist in einem Text ebenfalls über ein mögliches Bewusstsein in AI-Systemen spekuliert, woraufhin Douglas “Gödel, Escher, Bach” Hofstadter himself ebenfalls ebenfalls einen Beitrag zum Thema schrieb: “Artificial neural networks today are not conscious”.

Google beurlaubte LeMoine schließlich, nachdem er mit der Washington Post über seine Arbeit gesprochen hatte und seit dem wird die Debatte unter Experten weitergeführt, mit guten und hochinteressanten Argumenten auf allen Seiten.

Gary Markus, einer der bekanntesten Kritiker, veröffentlichte auf seinem Substack-Newsletter ("a no-bullshit look at AI progress and hype") einen Artikel, der sich mit LeMoines "Nonsense on stilts" beschäftigte, und legte schließlich in einem längeren Stück auf iai.tv noch einmal nach: "Google's AI is not sentient. Not even slightly." NYMag-Kolumnist Max Read fragte sich auf seinem Blog leicht amüsiert, ob LaMDA der Mount Everest sei.

Andere Stimmen sind vorsichtiger, so legt etwa der Substack-Blogger Philosophybear dar, warum LeMoine tendenziell richtig liegen könnte, da LaMDA zwar keine Zeichen von tatsächlicher Empfindsamkeit zeigte, aber als Meta-Chatbot-System (LaMDA ist ein Programm zur Erzeugung vieler "kleinerer" Chatbots für spezialisierte Anwendungen) in der Lage ist, Persönlichkeiten zu erzeugen, denen man eine rudimentäre Menschlichkeit unterstellen könnte. In einem zweiten Artikel wendet er sich direkt an LeMoines Kritiker und attackiert das in AI-Kreisen bekannte Gedankenexperiment des Chinesischen Zimmers des Philosophen John Searle.

Der von mir gepiqte Text auf Wired beschäftigt vor allem mit dem Hype um die Debatte selbst und die philosophischen Verantwortlichkeiten von AI-Experten, deren intellektuelle Experimentierfreude bereits heute zu Wahrnehmungsverzerrungen unter Menschen führen, die in direktem Kontakt mit AI-Systemen kommunizieren.

Mich persönlich interessieren an dieser spannenden Debatte zwar (natürlich) auch die Aspekte künstlichen Bewusstseins, vor allem aber die Auswirkungen auf unser Selbstbild, wie sich Diskussionen um AI-Consciousness auf unser eigenes bewusstes Empfinden auswirken und wie sich dank neuartiger, digitaler "menschenähnlich-kognitiver" Systeme unsere eigene Wahrnehmung der Welt verändert. Ich bemerke bei mir selbst etwa, wenn ich als gelernter Typograph und Grafik-Designer durch tausende Bilder des Image-Generators Dall-E 2 scrolle, eine Veränderung der Wahrnehmung von echten Fotografien, die ich zumindest zeitweise innerlich als "nicht AI-erzeugt" validieren muss.

Bereits digitale Vernetzung und soziale Medien haben eine immense Wirkung auf die menschliche Psychologie entfaltet, AI-Systeme werden diese perzeptiven Disruptionen der menschlichen Psyche nur weiter anheizen.

Tatsache ist, dass niemand mit Sicherheit sagen kann, ob und wann AI-Systeme so etwas wie ein Bewusstsein erlangen und ob wir überhaupt in der Lage sind, ein künstliches Bewusstsein zu erkennen und ob dieses überhaupt mit einem menschlichen Bewusstsein vergleichbar ist -- oder aber eine völlig neue Kategorie perzeptiver Erfahrung darstellt. Uns Menschen bleibt zum jetzigen Zeitpunkt nur die Frage: "If you can't tell, does it matter?"

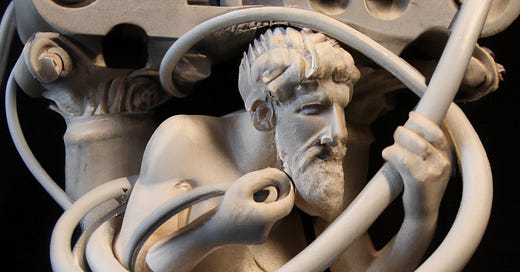

Die Welt des Blade Runner ist bereits 2022 in der Wirklichkeit angekommen.

(Ursprünglich veröffentlicht auf Piqd.)

Komplexitäten der Social Media Kritik

Nachdem Jonathan Haidt im Magazin The Atlantic vor einigen Wochen mit seinem Artikel "After Babel" (hier in einer deutschen Übersetzung auf piqd) für Aufsehen sorgte, rundet Gideon Lewis-Kraus im New Yorker das Bild ab und schreibt über die Kritiker von Haidts Artikel und die Komplexitäten der Social Media-Kritik.

Jonathan Haidt ist wahrscheinlich (neben Lanier und dem Autor dieses piqs) einer der schärfsten Kritiker moderner sozialer Medien, aber genau wie der im Artikel zitierte Soziologe Chris Bail bezweifle ich stark, dass sich durch Design-Änderungen der Plattformen sehr viel ändern wird.

Auch Haidt gibt in seinen Artikeln zu, dass seine Vorschläge nur dazu geeignet sind, die gröbsten Probleme (etwa Mental Health-Issues unter Teenagern) zu lindern. Generell dürften aber andere Feed-Algorithmen und Änderungen am Plattform-Design nur geringe Auswirkungen auf Phänomene wie Selbstsortierung von Nutzern in Echo Chambers oder Empörungskaskaden haben – und die gängige Plattform-Kritik unterschätzt oft den menschlichen Faktor und die Effekte menschlicher Psychologie in einer digitalen Medien-Umgebung.

Letztlich sind es die Möglichkeiten der Vernetzung in Kombination mit menschlichen und allzu menschlichen Motivationen, die die letzten 10 Jahre so "außergewöhnlich dumm" machten und genau deshalb habe ich die Phänomene jahrelang unter dem Stichwort "Neues Geiles Internet" beschrieben: Weil es allzu viele schlichtweg antörnt, mit Leuten im Internet zu streiten (und zu gewinnen!), weil Menschenjagd im Netz ein Thrill für alle ist und weil der "Kick der Veröffentlichung", von dem Journalisten so gerne reden, nun ein demokratisiertes, weltweites Phänomen darstellt. Das moderne Internet ist eine emotionale, affektgesteuerte und für Manipulationen extrem anfällige Medienumgebung, weit mehr, als es die Boulevardmedien vor dreißig Jahren jemals wahren.

Und genau diese vernetzten menschlichen Faktoren, die alten psychologischen Phänomene in einer neuen digital-medialen Umgebung, sorgen für eine Komplexitätsexplosion der Medienkritik.

Denn Gideon Lewis-Kraus' Text handelt gar nicht so sehr von Haidts Artikel, eigentlich geht es um das widersprüchliche Eigenleben der Google Docs, die Haidt für seine Arbeit angelegt hat. Hier etwa eine Stelle über die Ergebnisse zweier Studien zu Echo Chambers und Filterbubbles:

“Our results show that the aggregation of users in homophilic clusters dominate online interactions on Facebook and Twitter,” which seems convincing—except that, as another team has it, “We do not find evidence supporting a strong characterization of ‘echo chambers’ in which the majority of people’s sources of news are mutually exclusive and from opposite poles.” By the end of the file, the vaguely patronizing top-line recommendation against simple summation begins to make more sense. A document that originated as a bulwark against confirmation bias could, as it turned out, just as easily function as a kind of generative device to support anybody’s pet conviction.

Ich kenne beide Studien und beide ergeben Sinn, wenn man sie zusammen mit den Ergebnissen einer dritten Studie liest (die ebenfalls in Haidts Google Doc verlinkt wird), laut der wir tatsächlich trotz Filterbubbles *mehr* Inhalte politisch gegensätzlicher Haltungen lesen und teilen -- aber eben nur um sie vorzuführen, lächerlich zu machen, zu beschimpfen und damit die Bindungen zu den Peers der eigene Echo Chamber zu stärken. Die Forscher der Studie sprechen von "perverse incentives for divisive content". (Laut weiteren Studien sind die maßgeblichen Driver dieser Dynamik übrigens Politiker.)

Das ist nur einer der vielen hochkomplexen Zusammenhänge alleine im Bereich von Filterbubbles und Echo Chambers und die sind nur eines von sehr vielen unterschiedlichen Problemfeldern. Jede Plattform addiert psychologische Mikro-Dynamiken durch Algorithmus- und UX-Design, variiert durch anvisierte Zielgruppen und deren psychologische Zusammensetzungen. Je nach Persönlichkeit und Peer-Group spielen alle Social Media-Plattformen und Design-Elemente mit allen psychologisch-sozialen Phänomenen eine Runde "Reise nach Jerusalem" und wer keinen Stuhl erhält, kriegt Depressionen. Filterbubbles führen den einen in die Magersucht, die andere macht durch Radikalisierungseffekte in einer Echo Chamber Karriere, und noch einmal andere machen Kunst damit.

The only sane response, it seemed, was simply to throw one’s hands in the air.

Die Komplexitätsexplosion durch die Beschleunigung und Intensivierung praktisch aller menschlichen psychosozialen Phänomene durch soziale Medien erfordert eine hellsichtige, umfassende, wissenschaftlich fundierte und lager-übergreifend berichterstattende Kritik. Das ist wahrscheinlich zu diesem Zeitpunkt das Einzige, das sich mit Sicherheit über die Psychologie sozialer Medien sagen lässt.

(Ursprünglich veröffentlicht auf Piqd.)

Studie über den Wert unbezahlter Content-Moderation

Wenn es um Content-Moderation geht, bin ich ein "maximalistischer Humanist". Ich denke nicht, dass die Myriaden von potenziellen Konflikten und Problemen, die sich durch digitale Vernetzung von Menschen ergeben, von künstlichen Intelligenzen wirklich aufgefangen werden können. Hatespeech-Filter können sicherlich ein Werkzeug sein, aber die (para-)sozialen Beziehungen in sozialen Medien sind vielschichtig und komplex und erfordern meines Erachtens noch für eine sehr lange Zeit menschliches Urteilsvermögen und soziale Fähigkeiten, die (bislang) noch Menschen vorbehalten sind. Auch deshalb lagern Plattformen die Arbeit der Content Moderation gerne an unbezahlte Arbeitskräfte aus der Community aus. Vor fünfzehn Jahren bezeichnete man das im Kontext des damaligen Buzzwords Web2.0 noch als "AAL-Prinzip": Andere arbeiten lassen.

Nun haben zwei Studien den Wert der Moderationsarbeit ermittelt, der auf der Plattform Reddit von unbezahlten Moderatoren erarbeitet wird. Reddit ist eine der ältesten Social Media-Plattformen im Netz und weist einige interessante Eigenschaften auf, die sie von etwa Facebook oder Twitter unterscheiden. So gruppieren sich Menschen auf Reddit rund um sogenannte Subreddits zu unterschiedlichsten Themen, die persönlichen Accounts der User treten gegenüber diesen Interessensgruppen in den Hintergrund, und alle Teilnehmer, inklusive der Moderatoren, agieren auf Reddit viel mehr als "Schwarm", als das auf Twitter oder Facebook der Fall ist, wo der einzelne Account viel eher den Fokus der Sichtbarkeit ausmacht.

Vor diesem Hintergrund ist es interessant, wenn die beiden Studien nun zu dem Ergebnis kommen, dass die unbezahlten Moderatoren auf Reddit einen Wert von mindestens 3,4 Millionen Dollar erwirtschaften, oder rund 3% von Reddits Umsatz. Eine Zahl, die meiner persönlichen Einschätzung sehr viel zu niedrig ausfällt, auch da Content Moderation von Plattformen intern bereits als "gefährlicher Beruf" anerkannt wurde und manche Arbeitsverträge sogar "PTSD-Klauseln" enthalten. Die psychologischen Folgen des Berufs sind bereits seit Jahren bekannt. (Ich frage mich, ob die Wissenschaftler in ihrer Einschätzung über den Wert der Content Moderation die relative "Gefährlichkeit" der Subreddits in ihre Berechnungen mit einbezogen – die Moderation eines Subs namens "Weird Brutal Crap from the Underground" ist sicherlich ein härterer Job als die Moderation des Subs für die Sendung mit der Maus.)

Meines Erachtens werden die explosionsartig ansteigende Zahl der (para)sozialen Beziehungen auch neue "Sozialarbeiter"-Jobs erfordern, "digitale Streetworker" etwa, die zwischen "Trollbanden" und Opfern vermitteln, oder eben hauptberufliche Content-Moderatoren, deren Job weit mehr beinhaltet, als Bilder zu löschen.

Eine genaue Taxierung des Wertes dieser Arbeit ist überfällig.

(Ursprünglich veröffentlicht auf Piqd.)

Jonathan Haidt vs Mark Zuckerberg: The Case Against Social Media

Podcaster Lex Fridman führte vor rund drei Monaten ein ausführliches Interview mit Mark Zuckerberg, in dem er unter anderem auch Stellung zu der immer lauter werdenden Kritik bezog, die in Social Media und insbesondere dem Geschäftsmodell eine der Ursachen für steigende Mental Health-Issues unter Teenagern und dem stetig anwachsenden Misstrauen gegenüber demokratischen Institutionen sieht.

Kurz darauf veröffentlichte der international renommierte Moralpsychologe Jonathan Haidt einen Artikel im Magazin The Atlantic (mein piq des Artikels), der einen Kulminationspunkt seiner Arbeit aus den vergangenen Jahren darstellt.

Stellte Haidt in seinem zuvor veröffentlichten Buch "The Coddling of the American Mind" noch die These auf, dass Helicopter-Parenting zu neuen Sicherheitsbedürfnissen ("Safe Spaces") bei heranwachsenden Generationen und damit zu Unruhen an Universitäten geführt hätten, so hatte er damals die umfassende Rolle sozialer Medien nicht bedacht und nur halbherzig in seine Untersuchungen einfließen lassen. Diese Haltung hat sich in den vergangenen Jahren geändert und Haidt wurde zu einem der weltweit prominentesten und lautesten Kritiker sozialer Medien und dem ihnen zugrunde liegenden Geschäftsmodell.

Lex Fridman hat nun ein knapp zweistündiges, ausführliches Interview mit Jonathan Haidt geführt, in dem sie auf die Hintergründe all der psychologischen Phänomene eingehen, die durch soziale Medien verursacht werden und die nicht nur von den CEOs der Plattformen gerne kleingeredet werden, sondern auch von Netzaktivisten und den üblichen Techno-Utopisten. So wurde etwa in meiner Bubble vor einigen Jahren eine Studie herumgereicht, die feststellte, dass die Nutzung sozialer Medien dieselben Effekte auf die Psyche eines Menschen hätte, wie das Essen von Kartoffeln. Ein Blick in die Studie zeigte schon damals, dass sie lediglich Screentime untersuchte und etwa Gaming und Social Media nicht unterschied, sie daher also keine Aussage über soziale Medien treffen konnte.

Jonathan Haidt und Fridman gehen auf solche und viele andere Details zur Social Media-Debatte ein. Das Interview ist ein must-watch für jeden, der sich für die psychologischen Hintergründe der Verwerfungen unserer neuen tollen vernetzten Welt interessiert.

Hier noch der Link zu dem im Interview angesprochenen 190-seitigen Google-Doc: Social Media and Mental Health: A Collaborative Review, sowie der Link zu Haidts Aussage (PDF) vor dem Justizausschuss des amerikanischen Senats. Weitere Links auf der Website von Haidt.

(Ursprünglich veröffentlicht auf Piqd.)